記事の内容

AIや機械学習が、これからの社会を作っていきます。

この記事では、エンジニアがどういった局面で倫理について考えていくべきなのか説明していきたいと思います。

機械学習とは何か?

機械学習とは、今までのプログラミングとは異なります。

今までのプログラミングの場合は、ある特定のインプットに対して、人間が設計したアルゴリズムに沿ったアウトプットが出力されます。

でも、機械学習の場合は、ある特定のインプットに対して、AIがなんとなく素晴らしいと思ったアウトプットが出力されます。

その2つを比較した場合に、「人間が設計したアルゴリズムの方が素晴らしいはずに決まっている」と思う人も多いはずです。

でも、現実は逆で、機械が出したアウトプットの方が素晴らしいものになっています。

そのため、2010年頃は、「囲碁においてAIが人間に勝つのは数十年先だ」と言われていたのですが、2017年ぐらいの時点で、囲碁においてもAIが人間に圧勝するようになりました。

そして、今では残念なことに、AIが打つ手を人間が理解できない程に差がついてしまっています。

Googleではこの状態を、「データの理不尽なほどの強力さ」と読んでいるそうです。

つまり、我々が想像していそうな世界は以下の黒枠のようなものですが、現実は赤枠のようになっています。

ただし、AIがなんとなく出した回答に至る経緯はブラックボックスです。

雇用アルゴリズムを考えてみよう

「AIがなんとなく出した素晴らしい回答」を使って、人材の採用を行うことを想像してみましょう。

ある社員は3ヶ月の試用期間を経て、問題がなければ正社員として採用されると仮定します。

AIは、以下のようなことができるとします。

ただし、AIにインプットすることは勤怠状況だけで、年齢、性別、人種、宗教などのインプットは、一切与えません。

- 鬱になりやすい人を高確率で判別することができる

- 休みがちな人を高確率で判別することができる

- 会社を辞めやすい人を高確率で判別することができる

その結果、AIは合理的だと思われる以下のような判断をするかもしれません。

これは許されるの?

- 多くの女性(だと推測される人)を採用しない

- 将来、妊娠しそうな人(まだ妊娠していない人)を判断して、その人を採用しない

- 将来、うつ病になりそうな人(まだうつ病ではない人)を判断して、その人を採用しない

- ある特定の人種を採用しない

でも、その理由をAIに尋ねても、AIはその経緯を決して教えてはくれません。

もしかしたら、AIにだけは、わかっている根拠があるのかもしれません。

それでも、その結果として「女性や特定の人種を採用しないこと」は倫理的に許されるのでしょうか?

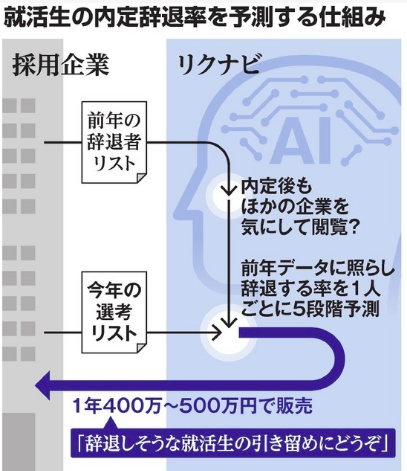

日本では、実際に、リクナビが内定辞退率を予測するシステムを販売して話題になっていました。

このAIが、内定を出す時に使われていた可能性は否めません。

だとすれば、このAIが、どのようなロジックで内定辞退率を算出していたのか、気になるところです。

もし、そのロジックに性別や年齢などが入っていれば、大きな問題になるかもしれません。

自動運転アルゴリズムを考えてみよう

「AIがなんとなく出す回答」とは別の話ですが、自動運転のアルゴリズムを作るためには、人間が作った倫理が必要です。

例えば、右にハンドルを切れば男性が3人、左にハンドルを切れば女性が3人いたとします。

その場合に、車は左右のどちらに進むべきでしょうか?

男性3人と女性3人のどちらを轢き殺すべきでしょうか?

その場合には、男性3人を轢き殺すプログラミングを書く人が多いかもしれません。

でも、もし、男性4人と女性3人では、どちらが優先されるべきでしょうか?

さらに言えば、年齢なども考慮する必要があるかもしれません。

それらのことに正解はなく、全ては倫理の問題になります。

まとめ

この記事では、AIを利用する社会の可能性について書きました。

AIは合理的で正しい判断をする可能性が高いのですが、その内容が必ずしも人間を幸福にするとは限りません。

そういった時に必要とされるのが倫理なので、AIを作るエンジニアには倫理を学ぶことが必須の時代なのかもしれません。

Good luck for your engineer life!

この記事が面白かった人は、こちらの記事も読んでみて下さい。